Machine Learning vs Deep Learning vs KI: Unterschiede Erklärt

Wenn Sie sich jemals von den Begriffen Künstliche Intelligenz, Machine Learning und Deep Learning verwirrt gefühlt haben, sind Sie nicht allein. Diese Konzepte sind in aller Munde, aber ihre Unterschiede sind nicht immer klar. In diesem vollständigen Leitfaden erklären wir genau, was jeder Begriff bedeutet, wie sie miteinander zusammenhängen und wann Sie jeden Begriff korrekt verwenden.

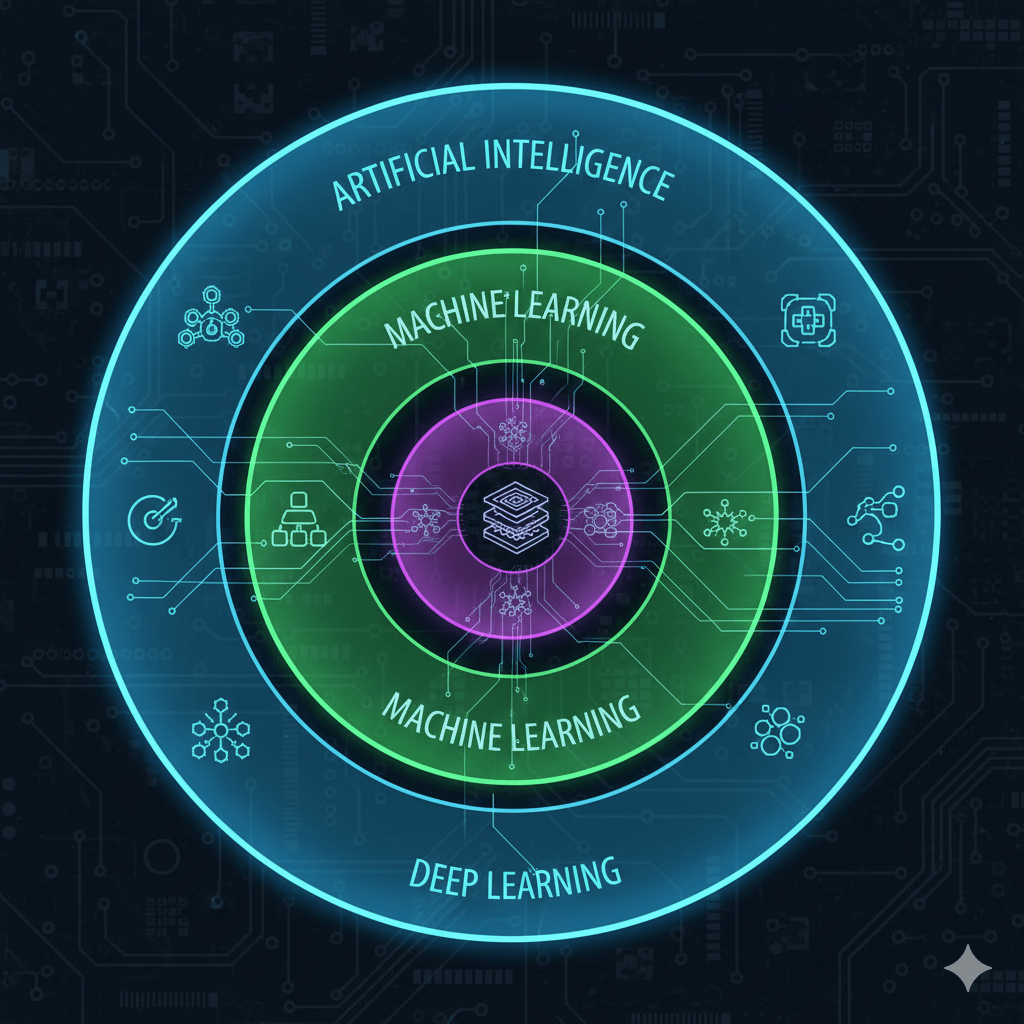

Die Hierarchische Beziehung: KI > ML > DL

Bevor wir uns in die Unterschiede vertiefen, ist es entscheidend zu verstehen, dass diese drei Konzepte nicht auf derselben Ebene stehen. Sie bilden eine Hierarchie, in der jedes das nächste enthält:

🧠 KÜNSTLICHE INTELLIGENZ (Breiter)

└── 🤖 MACHINE LEARNING

└── 🔥 DEEP LEARNING (Spezifischer)

Einfache Analogie

Denken Sie daran wie an russische Puppen:

- KI ist die größte Puppe, die alles enthält

- Machine Learning ist die mittlere Puppe

- Deep Learning ist die kleinste und innerste Puppe

Was ist Künstliche Intelligenz (KI)?

Vollständige Definition

Künstliche Intelligenz ist das breiteste Feld der Informatik, das darauf ausgerichtet ist, Systeme zu schaffen, die Aufgaben ausführen können, die typischerweise menschliche Intelligenz erfordern.

Eigenschaften der KI

- Problemlösung bei komplexen Aufgaben

- Automatisierte Entscheidungsfindung

- Verständnis natürlicher Sprache

- Mustererkennung

- Planung und Reasoning

Arten von KI

1. Regelbasierte KI (Klassisch)

- Funktionsweise: System vordefinierter “wenn-dann”-Regeln

- Beispiel: Medizinisches Expertensystem, das auf spezifischen Symptomen basiert diagnostiziert

- Vorteile: Vorhersagbar und erklärbar

- Nachteile: Starr und begrenzt

2. Datenbasierte KI (Modern)

- Funktionsweise: Lernt aus Daten, um Entscheidungen zu treffen

- Beispiel: Netflix-Empfehlungsalgorithmen

- Vorteile: Anpassbar und verbessert sich mit mehr Daten

- Nachteile: Weniger vorhersagbar, “Black Box”

Alltägliche Beispiele für KI

✅ Virtuelle Assistenten (Siri, Alexa, Google Assistant)

✅ GPS-Navigationssysteme (Google Maps, Waze)

✅ Suchmaschinen (Google, Bing)

✅ Empfehlungssysteme (YouTube, Spotify, Amazon)

✅ Kundenservice-Chatbots

✅ Spam-Erkennung in E-Mails

✅ Autokorrektur von Text

Was ist Machine Learning (ML)?

Präzise Definition

Machine Learning ist eine Untermenge der KI, die es Maschinen ermöglicht, automatisch aus Daten zu lernen und sich zu verbessern, ohne explizit für jede spezifische Aufgabe programmiert zu werden.

Kernkonzept

Anstatt spezifische Regeln zu programmieren, macht ML:

- Füttert Daten an den Algorithmus

- Findet Muster automatisch

- Macht Vorhersagen basierend auf diesen Mustern

- Verbessert sich mit mehr Daten und Erfahrung

Arten von Machine Learning

1. Überwachtes Lernen (Supervised Learning)

- Definition: Lernt aus beschrifteten Beispielen

- Prozess: Input → Algorithmus → Gewünschte Ausgabe

- Beispiele:

- E-Mail-Klassifikation (Spam/kein Spam)

- Hauspreisvorhersage

- Medizinische Diagnose durch Bilder

Praktisches Beispiel:

Trainingsdaten:

🏠 Haus: 3 Zimmer, 120m² → Preis: €200.000

🏠 Haus: 2 Zimmer, 80m² → Preis: €150.000

🏠 Haus: 4 Zimmer, 160m² → Preis: €280.000

Vorhersage neues Haus:

🏠 Haus: 3 Zimmer, 100m² → Preis: €185.000 (Vorhersage)

2. Unüberwachtes Lernen (Unsupervised Learning)

- Definition: Findet Muster in unbeschrifteten Daten

- Prozess: Input → Algorithmus → Versteckte Muster

- Beispiele:

- Kundensegmentierung

- Anomalie-Erkennung

- Empfehlungssysteme

Praktisches Beispiel:

E-Commerce-Kundendaten (unbeschriftet):

👤 Kunde A: Kauft Bücher, Kaffee, klassische Musik

👤 Kunde B: Kauft Videospiele, Energy-Drinks, Kopfhörer

👤 Kunde C: Kauft Bücher, Kaffee, Dokumentationen

Entdecktes Muster:

📚 Gruppe 1: "Intellektuelle" (A, C)

🎮 Gruppe 2: "Gamer" (B)

3. Verstärkendes Lernen (Reinforcement Learning)

- Definition: Lernt durch Trial und Error

- Prozess: Aktion → Ergebnis → Belohnung/Bestrafung → Verbesserung

- Beispiele:

- Videospiele (AlphaGo, OpenAI Five)

- Autonome Fahrzeuge

- Algorithmisches Trading

Beliebte ML-Algorithmen

Klassische Algorithmen

- Lineare Regression: Vorhersage numerischer Werte

- Entscheidungsbäume: Klassifikation durch Regeln

- Support Vector Machines: Klassifikation mit optimalen Margen

- Random Forest: Kombination multipler Bäume

- K-Means: Clustering ähnlicher Daten

Wann Klassisches ML verwenden

✅ Kleine bis mittlere Datasets (Tausende bis Hunderttausende von Datensätzen)

✅ Gut definierte Probleme mit klaren Merkmalen

✅ Bedarf an Erklärbarkeit (wissen, warum es etwas entscheidet)

✅ Begrenzte Rechenressourcen

✅ Kurze Entwicklungszeit

Was ist Deep Learning (DL)?

Technische Definition

Deep Learning ist eine Untermenge des Machine Learning, die künstliche neuronale Netzwerke mit mehreren Schichten (tief) verwendet, um komplexe Muster in Daten zu modellieren und zu verstehen.

Biologische Inspiration

Künstliche neuronale Netzwerke sind vom menschlichen Gehirn inspiriert:

- Künstliche Neuronen ≈ Biologische Neuronen

- Gewichtete Verbindungen ≈ Synapsen

- Schichten ≈ Verschiedene Gehirnbereiche

- Lernen ≈ Stärkung von Verbindungen

Deep Learning Architektur

Schlüsselkomponenten

- Eingabeschicht: Empfängt die Daten (Bild, Text, Audio)

- Versteckte Schichten: Verarbeiten und transformieren Informationen (können Dutzende oder Hunderte sein)

- Ausgabeschicht: Produziert das finale Ergebnis (Klassifikation, Vorhersage)

Einfache Visualisierung

INPUT → [Schicht 1] → [Schicht 2] → [Schicht 3] → ... → [Schicht N] → OUTPUT

Daten Basis- Einfache Komplexe Finale

kanten Formen Objekte Entscheidung

Arten Neuronaler Netzwerke

1. Konvolutionale Neuronale Netzwerke (CNN)

- Spezialität: Bildverarbeitung

- Anwendungen: Gesichtserkennung, medizinische Diagnose, autonome Fahrzeuge

- Beispiel: Erkennen, ob ein Foto eine Katze enthält

2. Rekurrente Neuronale Netzwerke (RNN/LSTM)

- Spezialität: Sequenzen und Zeitreihen

- Anwendungen: Übersetzung, Sentiment-Analyse, Aktienvorhersage

- Beispiel: Automatisches Vervollständigen von Sätzen

3. Transformer

- Spezialität: Verarbeitung natürlicher Sprache

- Anwendungen: ChatGPT, Google Translate, Zusammenfassungssysteme

- Beispiel: Generierung kohärenten und kontextuellen Textes

4. Generative Adversarial Networks (GANs)

- Spezialität: Erstellung neuer Inhalte

- Anwendungen: Bilderstellung, Deepfakes, digitale Kunst

- Beispiel: Generierung menschlicher Gesichter, die nicht existieren

Revolutionäre Deep Learning Beispiele

🎯 GPT-4: Menschliche Textgenerierung

🖼️ DALL-E: Bilderstellung aus Text

🔍 Google Lens: Erweiterte visuelle Erkennung

🚗 Tesla Autopilot: Autonomes Fahren

🎵 Spotify DJ: Personalisierte Musikempfehlungen

🎬 DeepFake: Realistische Videosynthese

🏥 Radiologie-KI: Krebserkennung in medizinischen Bildern

Wann Deep Learning verwenden

✅ Massive Datasets (Millionen von Datenpunkten)

✅ Komplexe Probleme (Bilder, Audio, Text, Video)

✅ Nicht-offensichtliche Muster, die Menschen schwer erkennen können

✅ Reichlich Rechenressourcen (leistungsstarke GPUs)

✅ Genauigkeit wichtiger als Erklärbarkeit

Direkter Vergleich: KI vs ML vs DL

Vollständige Vergleichstabelle

| Aspekt | Künstliche Intelligenz | Machine Learning | Deep Learning |

|---|---|---|---|

| Definition | Breites Feld intelligenter Systeme | KI-Untermenge, die aus Daten lernt | ML-Untermenge mit tiefen neuronalen Netzwerken |

| Umfang | Sehr breit | Breit | Spezifisch |

| Benötigte Daten | Variabel | Tausende bis Millionen | Millionen bis Milliarden |

| Rechenressourcen | Variabel | Moderat | Sehr hoch (GPUs) |

| Trainingszeit | Variabel | Minuten bis Stunden | Stunden bis Wochen |

| Erklärbarkeit | Abhängig von Methode | Mittel | Niedrig (“Black Box”) |

| Typische Genauigkeit | Variabel | Gut | Ausgezeichnet |

| Anwendungsbeispiele | Chatbots, GPS, Suchen | Spam-Erkennung, Empfehlungen | Bilderkennung, LLMs |

Implementierungskomplexität

🟢 Einfach: Regelbasierte KI

# Beispiel: Einfaches Empfehlungssystem

if benutzer_alter < 18:

empfehlen("Familieninhalt")

elif benutzer_geschlecht == "männlich":

empfehlen("Sport, Technologie")

else:

empfehlen("Mode, Lifestyle")

🟡 Mittel: Klassisches Machine Learning

# Beispiel: E-Mail-Klassifikation

from sklearn.naive_bayes import MultinomialNB

modell = MultinomialNB()

modell.fit(training_emails, spam_labels)

vorhersage = modell.predict(neue_email)

🔴 Fortgeschritten: Deep Learning

# Beispiel: Neuronales Netzwerk für Bilder

import tensorflow as tf

modell = tf.keras.Sequential([

tf.keras.layers.Conv2D(32, (3,3), activation='relu'),

tf.keras.layers.MaxPooling2D(2,2),

tf.keras.layers.Conv2D(64, (3,3), activation='relu'),

# ... multiple zusätzliche Schichten

])

Anwendungsfälle nach Kategorie

Wann traditionelle KI verwenden?

- Expertensysteme (medizinische Grunddiagnose)

- Einfache Prozessautomation

- Chatbots mit vordefinierten Antworten

- Industrielle Kontrollsysteme

- Datenvalidierung und Geschäftsregeln

Wann Machine Learning verwenden?

- Prädiktive Analysen (Verkäufe, Nachfrage)

- Kundensegmentierung

- Betrugserkennung

- Basis-Empfehlungssysteme

- Einfache Sentiment-Analyse

- Preisoptimierung

Wann Deep Learning verwenden?

- Bildverarbeitung (medizinisch, Satellit)

- Spracherkennung und Synthese

- Fortgeschrittene automatische Übersetzung

- Inhaltsgenerierung (Text, Bilder)

- Autonome Fahrzeuge

- Komplexe medizinische Diagnose

- Strategische Spiele (Schach, Go)

Historische Entwicklung

KI-Zeitlinie

1950er-1960er: Grundlagen

- 1950: Turing-Test

- 1956: “Künstliche Intelligenz” geprägt

- 1957: Perceptron (erstes neuronales Netzwerk)

1970er-1980er: Erste Expertensysteme

- Regelbasierte Systeme

- MYCIN (medizinische Diagnose)

- Erster “KI-Winter”

1990er-2000er: Aufstieg des Machine Learning

- Support Vector Machines

- Random Forests

- Fortgeschrittene Clustering-Algorithmen

2010er-Heute: Deep Learning Revolution

- 2012: AlexNet revolutioniert Computer Vision

- 2014: GANs transformieren Bildgenerierung

- 2017: Transformer verändern Sprachverarbeitung

- 2020: GPT-3 demokratisiert generative KI

- 2022: ChatGPT bringt KI zu den Massen

Mythen und Realitäten

❌ Häufige Mythen

Mythos 1: “KI, ML und DL sind dasselbe”

- Realität: Es sind hierarchische Konzepte mit verschiedenen Spezifikationsgraden

Mythos 2: “Deep Learning ist immer besser”

- Realität: Für einfache Probleme kann klassisches ML effizienter sein

Mythos 3: “Man braucht Deep Learning für KI”

- Realität: Viele KI-Anwendungen nutzen einfachere Methoden

Mythos 4: “Mehr Daten bedeuten immer bessere Ergebnisse”

- Realität: Datenqualität ist wichtiger als Quantität

Mythos 5: “KI bedeutet, dass Maschinen wie Menschen denken”

- Realität: Aktuelle KI ist sehr ausgeklügelte Mustererkennung

✅ Wichtige Realitäten

- Komplementarität: Die drei Ansätze können kombiniert werden

- Spezialisierung: Jeder hat seine optimalen Anwendungsfälle

- Kontinuierliche Entwicklung: Die Grenzen ändern sich weiterhin

- Werkzeuge: Sie sind Mittel zur Problemlösung, nicht Selbstzweck

Die Zukunft von KI, ML und DL

Aufkommende Trends

1. Hybride KI

- Kombination regelbasierter Systeme mit ML

- Bessere Erklärbarkeit und Kontrolle

- Beispiele: Medizinische Systeme, die Expertenwissen mit maschinellem Lernen kombinieren

2. Effizientes ML

- Algorithmen, die weniger Daten benötigen

- Few-shot Learning und Zero-shot Learning

- Kleinere Modelle mit gleicher Leistung

3. Spezialisiertes DL

- Domänenspezifische Architekturen (Medizin, Finanzen)

- Multimodale Modelle (Text + Bild + Audio)

- Neural Architecture Search (NAS)

4. Erklärbare KI

- Techniken zum Verstehen von “Black Box”-Entscheidungen

- LIME, SHAP und andere Interpretabilitätswerkzeuge

- Regulierungen, die Erklärbarkeit erfordern

Vorhersagen für 2030

🔮 Allgemeine Künstliche Intelligenz (AGI) näher aber noch nicht erreicht

🔮 AutoML wird ML-Modellentwicklung demokratisieren

🔮 Edge AI wird DL auf mobile Geräte bringen

🔮 Quantum ML wird praktische Vorteile zeigen

🔮 Nachhaltige KI fokussiert auf Energieeffizienz

Wie man den richtigen Ansatz wählt

Entscheidungsrahmen

Schritt 1: Definieren Sie Ihr Problem

- Was wollen Sie genau erreichen?

- Wie komplex ist das zu erkennende Muster?

- Müssen Sie erklären, wie es funktioniert?

Schritt 2: Bewerten Sie Ihre Ressourcen

- Wie viele Daten haben Sie verfügbar?

- Welche Rechenressourcen haben Sie?

- Wie viel Zeit können Sie investieren?

Schritt 3: Wenden Sie die Goldene Regel an

📊 < 1.000 Daten → Regelbasierte KI

📊 1.000 - 100.000 Daten → Klassisches Machine Learning

📊 > 100.000 komplexe Daten → Deep Learning

Schritt 4: Berücksichtigen Sie den Kontext

- Wie kritisch ist ein Fehler?

- Brauchen Sie Echtzeit-Updates?

- Gibt es spezifische Regulierungen?

Werkzeuge und Ressourcen zum Einstieg

Für traditionelle KI

- Sprachen: Python, Java, Prolog

- Werkzeuge: Expertensystem-Shells, Regel-Engines

- Kurse: CS50’s Introduction to AI

Für Machine Learning

- Sprachen: Python (scikit-learn), R

- Plattformen: Google Colab, Kaggle

- Kurse: Machine Learning Course (Andrew Ng)

Für Deep Learning

- Frameworks: TensorFlow, PyTorch, Keras

- Hardware: NVIDIA GPUs, Google TPU

- Kurse: Deep Learning Specialization (Coursera)

Häufig gestellte Fragen (FAQ)

Brauche ich fortgeschrittene Mathematik?

- Traditionelle KI: Grundlegende Logik

- Machine Learning: Statistik und lineare Algebra

- Deep Learning: Kalkül, lineare Algebra, fortgeschrittene Statistik

Was ist am einfachsten zu lernen?

- Regelbasierte KI (am einfachsten)

- Machine Learning (mittelschwer)

- Deep Learning (am schwersten)

Was hat die besten Jobaussichten?

Alle sind gefragt, aber:

- ML: Höhere aktuelle Nachfrage

- DL: Bessere Durchschnittsgehälter

- Traditionelle KI: Spezialisierte Nischen

Kann einer die anderen ersetzen?

Nicht vollständig. Jeder hat einzigartige Stärken und optimale Anwendungsfälle.

Fazit: Navigation im KI-ML-DL-Ökosystem

Das Verstehen der Unterschiede zwischen Künstlicher Intelligenz, Machine Learning und Deep Learning ist nicht nur eine akademische Übung; es ist eine wesentliche praktische Fähigkeit in der heutigen technologischen Welt.

Kernpunkte zum Merken

- Hierarchie: KI ⊃ ML ⊃ DL (jedes enthält das nächste)

- Zunehmende Spezialisierung: Von allgemein zu spezifisch

- Progressive Komplexität: Ausgeklügelter aber komplexer

- Differenzierte Anwendungsfälle: Jeder glänzt in spezifischen Kontexten

Die Goldene Regel

Verwenden Sie nicht einen Hammer für alles: Der beste Ansatz hängt von Ihrem spezifischen Problem, verfügbaren Daten und Ressourcen ab. Manchmal ist eine einfache “wenn-dann”-Regel effektiver als ein neuronales Netzwerk mit Millionen von Parametern.

Blick in die Zukunft

Die Grenze zwischen diesen Feldern wird sich weiter entwickeln. Zukünftige Systeme werden wahrscheinlich mehrere Ansätze kombinieren und die Stärken jedes einzelnen nutzen, während sie ihre Schwächen mildern.

Der Schlüssel zum Erfolg liegt nicht darin, nur eine Technik zu beherrschen, sondern zu verstehen, wann und wie jede anzuwenden ist.

In der Welt der KI gibt es keine universellen Lösungen, nur angemessene Werkzeuge für spezifische Probleme. Das Beherrschen der Unterschiede zwischen KI, ML und DL wird es Ihnen ermöglichen, das richtige Werkzeug für jede Herausforderung zu wählen.